Largement invisibilisé, le rôle des travailleurs du clic est pourtant essentiel dans l’élaboration des modèles d’IA générative. De retour d’un voyage au Kenya, l’artiste Quentin Sombsthay partage son expertise du sujet et les témoignages recueillis auprès des travailleurs de l’entreprise Sama, à Nairobi. Un univers cru, loin des paillettes des entreprises de la Silicon Valley.

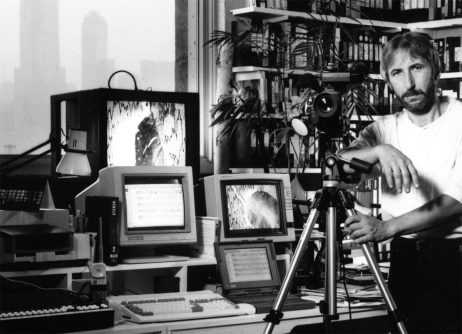

La prophétisation de l’ère de l’intelligence artificielle générative occulte une idéologie trompeuse : dans l’imaginaire collectif, ces modèles d’apprentissage automatique sont semblables aux comportements humains. On dit même qu’ils apprendraient de manière autonome. La réalité est toutefois différente dans le sens où ce sont bien des entreprises qui collectent des datas, puis optimisent leurs modèles afin d’en produire des représentations. Pire encore : une partie de ce travail est réalisé par une main-d’œuvre bon marché – les fameux travailleurs du clic -, située aux quatre coins du globe. Quentin Sombsthay prépare actuellement Image Latente, un documentaire hybride sur les travailleurs du clic de Nairobi, au Kenya. Immergé dans ce quotidien peu reluisant, l’artiste et cinéaste profite de ses recherches pour partager la réalité, violente et précaire, de ce que certains appellent le « nouveau prolétariat numérique ».

Qui sont les travailleurs du clic et quel est leur rôle dans l’élaboration des modèles d’IA générative ?

Quentin Sombsthay : Les travailleurs du clic sont payés pour ajuster les modèles d’IA et effectuent dès lors des tâches répétitives, comme filtrer des vidéos, classer des images ou transcrire de l’audio. Dans de nombreux cas, l’affinage humain reste plus efficace et surtout davantage rentable pour le tri des données. En général, ces travailleurs interviennent après une première passe automatique et viennent corriger ou détailler des données. C’est ce que l’on appelle le « human in the loop ». Pour donner un exemple concret : il a fallu que des travailleurs lisent et trient des textes au contenu violent afin que ChatGPT puisse se censurer et ne pas avoir de propos haineux et racistes générés. Les travailleurs du clic sont basés au Kenya, à Madagascar, en Malaisie, aux Philippines. Partout où la main-d’œuvre est « bon marché ».

On parle parfois de « nouveau prolétariat du numérique ». Est-ce une expression qui vous semble juste ?

QS : C’est une formule empruntée à Antonio Casilli, l’auteur d’une grande enquête sur le sujet (En attendant les robots, publié aux éditions du Seuil, ndlr). Dans ce livre, ce sociologue démontre combien ce travail invisible, qui est lié aux plateformes et aux datas, reproduit une dichotomie nord-sud. Le travail du clic est un job précaire réalisé par des millions de personnes et que l’on retrouve partout sur la planète. Parfois, ce sont des freelances aux États-Unis, des Philippins dans un cybercafé ou des milliers de travailleurs africains dans des fermes du clic. Il y a néanmoins des différences très importantes dans les conditions de travail. Tout en bas de l’échelle, on retrouve les travailleurs africains. Finalement, c’est une nouvelle dimension néocoloniale, loin de l’image épurée de la Silicon Valley. Le fait que les Big Tech invisibilisent ce travail sous-entend que celui-ci n’est pas très important – pourtant, il est essentiel. L’un des travailleurs que j’ai rencontré au Kenya m’a dit : « Il n’y a pas d’intelligence artificielle, seulement l’intelligence africaine. » Ça résume assez bien les choses.

« Le travail du clic est un job précaire réalisé par des millions de personnes et que l’on retrouve partout sur la planète. »

À titre personnel, comment en êtes-vous arrivé à vous intéresser à une entreprise basée à Nairobi ?

QS : En 2023, je suis tombé sur un article du Times qui parlait d’une entreprise appelée Sama et localisée à Nairobi. Ses clients sont des sociétés comme META, Google, Tesla, OpenAI, etc. L’article expliquait comment ces entreprises ont mis en place la censure sur ChatGPT et généré des séquelles sur les travailleurs. La réalité, c’est que Sama donne du travail à peut-être 1 000 ou 2 000 personnes à Nairobi, qu’une partie du travail consiste à lire des centaines de description violentes – des meurtres, des viols, des accidents – et de les trier. Ces travailleurs souffrent de visions récurrentes et de troubles post-traumatiques. Je me suis donc intéressé à ces images mentales, à la santé psychologique.

Comment est organisé le travail à Sama ?

QS : Il y a principalement deux pôles : celui des content moderators et celui des AI workers. La première personne avec qui j’ai discuté était content moderator. Son rôle était de filtrer Facebook, c’est-à-dire de regarder les vidéos signalées, puis de les retirer si nécessaire. Cette personne venait d’Ethiopie pour fuir la guerre civile. Chose cynique, elle s’est retrouvée à trier des images qui venaient de la guerre civile du pays qu’elle avait fui… Ensuite, j’ai rencontré plusieurs AI workers, dont la mission est de qualifier un contenu. Est-ce un chat ? Un arbre ? De manière aléatoire, il peut parfois y avoir aussi l’image d’un cadavre ou une image pornographique.

On peut dès lors supposer que les conditions de travail sont également problématiques, non ?

QS : N’ayant pas pu pénétrer dans l’entreprise, je m’appuie sur le témoignage de travailleurs. Certains font mention de parcage des salariés dans des hôtels, sans qu’ils ne puissent sortir librement. Il y avait une navette quotidienne entre l’hôtel et Sama. Lorsqu’ils entrent dans le bâtiment, on leur confisque leur téléphone. Pas tant par peur de révéler les conditions de travail, mais plutôt par crainte de s’exposer à une fuite des données. Il faut s’imaginer qu’ils sont entre 1 000 et 2 000 dans un grand bâtiment. Ce n’est pas pour rien qu’on appelle ça un « sweatshop » (atelier de misère, clandestin, ndlr). L’entreprise tourne 24h/24h, 7/7. Les travailleurs sont des femmes et des hommes qui travaillent près de 10h par jour avec peu de temps de pause. Le tout payé l’équivalent d’environ 300 dollars mensuel. C’est un peu plus que le salaire minimum kényan, certes, mais ils doivent respecter un performing score. Autrement dit, les travailleurs sont regroupés en diverses équipes de vingt avec, à leur tête, un quality analyst dont l’objectif est de vérifier le travail. Si le score est trop bas, la pression managériale devient forte.

« L’entreprise tourne 24h/24h, 7/7. Les travailleurs sont des femmes et des hommes qui travaillent près de 10h par jour avec peu de temps de pause. Le tout payé l’équivalent d’environ 300 dollars mensuel. »

On imagine bien les conséquences psychologiques désastreuses…

QS : C’est assez différent selon les métiers. Néanmoins, le plus difficile est sans doute lié à la nature du travail : le tri des contenus violents sans soutien psychologique. Ce qui revient le plus souvent, c’est l’absence de vie sociale et une difficulté à parler. Les séquelles peuvent se manifester sous la forme de cauchemars, d’insomnies, de pensées intrusives, de perte d’appétit. Pour prendre la mesure des choses, l’une des tâches demandées pour le calibrage de ChatGPT consiste à analyser 300 pages par jour de contenus extrêmes. Ça peut être une description de viol, d’accident de voiture ou d’exécution. L’objectif est de classifier chaque contenu par typologie, « sexuel », « violent », « automutilation »…

Suite à ce premier repérage au Kenya, quelle va être la forme d’Image Latente ?

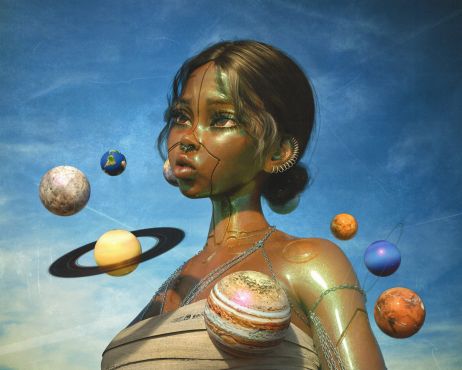

QS : Après une vingtaine d’heures de témoignage, j’ai envie de prendre l’angle de la santé mentale et du trouble post-traumatique. La forme de mon œuvre doit encore être précisée, mais je souhaite matérialiser ces séquelles de manière subtile et graphique. L’usage de l’IA générative trouvera une place dans mon œuvre, mais de manière cohérente, éthique, comme une sorte de mise en abîme. J’aimerais présenter une œuvre, un film ou une pièce hybride, à la fin de l’année 2025. D’ici là, je prévois d’approfondir mon travail en me rendant de nouveau à Nairobi.